« Ethical by Design », le véritable enjeu de l’IA

Compte-rendu de la matinale du Jeudi 3 Octobre 2019

Jeudi 3 Octobre 2019, l’équipe RespAI (Responsible Artificial Intelligence) d’OCTO Technology, qui s’intéresse à l’usage responsable des traitements algorithmiques des données, a accueilli des intervenants aux profils variés afin de discuter d’un nouvel enjeu de l’IA : “Ethical by Design”.

Ensemble, ils ont tenté de répondre aux questions suivantes :

- Pourquoi l’éthique a aujourd’hui une place majeure dans les discussions autour de l’IA ?

- Quel est le risque à l’ignorer, et surtout quels avantages une organisation peut-elle tirer de la mise en place de pratiques éthiques ?

- Comment gagner et/ou maintenir la confiance des utilisateurs dans un système IA ?

- Que peut apporter l’IA au domaine de la santé, avec toutes ses spécificités ?

Introduction

L’apport positif et l’efficacité de l’IA ne sont plus à prouver. Certains modèles dépassent même les capacités humaines, comme on a pu le constater grâce aux IA qui gagnent contre des champions de jeux stratégiques comme le Go ou les échecs, ou encore des IA capables de diagnostiquer un cancer mieux que des médecins. Maintenant que l’IA fait partie de notre vie quotidienne, certains scandales ont fait ressentir l’impact négatif potentiel de celle-ci. On peut mentionner la sélection de CVs sexiste (dûe à un biais dans les données d'entraînement) par Amazon, ou encore la voiture autonome d’Uber qui a percuté et tué un piéton.

Les organisations ont donc trois postures potentielles à adopter face à cette émergence des risques liés à l’IA :

- Choisir d’ignorer toute responsabilité, ce qui a été le comportement initial des grands groupes technologiques, et qui a causé plusieurs scandales

- Choisir d’éviter l’usage de l’IA par peur des risques qui y sont liés, ce qui a longtemps été le comportement adopté par le service public, et qui l’a fait passer à côté de plusieurs opportunités d’amélioration de service

- S’approprier l’IA tout en adoptant transparence et bonnes pratiques

Nous verrons par la suite en quoi la 3ème option est généralement la plus avantageuse.

La théorie derrière l’éthique

Le mathématicien Lê Nguyên Hoang insiste sur l’urgence et la complexité de rendre les IA bénéfiques pour les humains.

Thèse 1 : Rendre les IA bénéfiques est une urgence

La technologie en général, IA incluse, a un fort impact à grande échelle. Cet impact peut être positif, comme la réduction des morts infantiles ou la prospérité économique, ou négatif, comme les effets secondaires du ciblage personnalisé de contenu en ligne. On peut retrouver cela sur les réseaux sociaux tel Facebook, comme l’a montré le scandale de Cambridge Analytica, où il y a eu une volonté de manipulation politique de masse pendant les présidentielles américaines de 2016.

Ce ciblage de contenu pourrait être mieux encadré, et utilisé à des fins bénéfiques telle la détection d’utilisateurs potentiellement dépressifs, afin de les aider.

Thèse 2 : Rendre les IA bénéfiques est un défi monumental

Des algorithmes très performants, conçus par des leaders dans le monde de la technologie, peuvent se retrouver victimes d’attaques adversarial, comme :

- Attaques d’évasion : où un algorithme déjà mis en place va être trompé, comme pour la reconnaissance d’images où il suffit d’ajouter du bruit non détectable à l’oeil nu pour avoir un résultat totalement différent. Ceci pourrait expliquer pourquoi le filtre utilisé par Youtube a laissé passer plusieurs vidéos à caractère pédophile.

- Attaques d’empoisonnement : où on va cibler les données d’entraînement d’un algorithme, comme pour l’IA TayTweets nourrie par des trolls sur Twitter, ce qui lui a donné un caractère agressif, raciste et homophobe.

Un autre point rend le problème de l’éthique en IA encore plus complexe : comment définir ce qui est “bénéfique” ?

Nous, humains, avons des biais cognitifs qui sont peut-être contradictoires avec nos valeurs morales. Un utilisateur sur Youtube peut avoir une volonté à court terme de regarder une vidéo drôle, mais idéalement il aurait préféré vouloir regarder une vidéo à caractère scientifique, qui lui sera plus bénéfique sur le long terme. Ce genre de réflexion a donné naissance au concept de “volition cohérente extrapolée”, selon lequel une IA devrait agir selon notre intérêt supérieur, et non notre désir à court terme.

En pratique (Paroles d’Octos)

Avant de pouvoir trouver des solutions aux problèmes éthiques de l’IA, il est important de comprendre les raisons principales qui poussent les gens à se montrer méfiants.

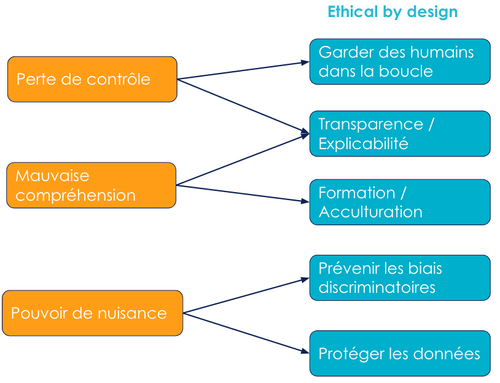

Un sondage Ifop pour Impact AI, un collectif d’entreprises françaises s’intéressant à l’impact social de l’IA, a permis d’identifier 3 axes d’inquiétude majeurs :

- Sentiment de perte de contrôle (Remplacement de l’humain, dépendance)

- Mauvaise compréhension du fonctionnement de l’IA

- Risque de dérive (mauvaise utilisation, non-respect des données personnelles)

Comment calmer ces craintes ? L’Ethical by Design vient en réponse à cette question, non pas en tant que solution toute prête mais en tant qu’état d’esprit et principes généraux qui orientent la réflexion en amont de tout projet autour de l’IA.

Garder les humains dans la boucle

La sortie de l’algorithme est généralement sous forme de probabilités. On peut automatiser les choix certains et laisser les utilisateurs décider quand l’incertitude est élevée, ce qui aurait pour résultat la mise en confiance de ces derniers ainsi que la réduction des erreurs.

Prévenir les biais discriminatoires

Plusieurs questions à se poser sur les données (Les distributions sont-elles équilibrées ? Quelles transformations à effectuer ?) et l’algorithme (Quel impact, à priori et à posteriori ? Quel choix de métrique ?)

Protéger les données

Julie Gallavardin, consultante chez OCTO, conseille de revenir à la raison d’être du RGPD (Règlement Général sur la Protection des Données), afin de se l’approprier comme démarche positive et valorisante et non comme outil contraignant.

Afin de bien cerner le “why” du RGPD, il faut revenir au contexte historique de l’organisme l’ayant créé : la CNIL (Commission Nationale de l’Informatique et des Libertés). Cette commission a vu le jour après la seconde guerre mondiale, en réponse au traumatisme des français dû au fichage, et donc à leur désir d’avoir une entité indépendante qui protégerait leurs données personnelles.

Mieux comprendre l’origine du RGPD et le pourquoi de ses principes peut aider à en tirer un avantage compétitif, comme pour SNIPS, start-up française qui tient tête à Alexa, produit du géant Amazon, en mettant en avant leur politique de Privacy by Design. On peut aussi mentionner Apple, qui fait de la protection des données un argument de vente majeur, ou encore Microsoft, qui utilise son hébergement des données en France dans ses publicités.

Transparence et explicabilité

Emmanuel-Lin Toulemonde, consultant chez OCTO, revient sur l’importance d’avoir un système IA interprétable.

Un système est dit interprétable s’il est :

- Explicable : peut apporter des explications et des commentaires sur ses résultats

- Transparent : a un fonctionnement intelligible par un humain

- Prouvable : peut apporter la preuve de la justesse du résultat

Afin d’identifier ce que l’on cherche concrètement en terme d’interprétabilité, quatre questions sont intéressantes à se poser :

- Pour qui : Un data scientist ? Un expert métier ? Un patient ? Un régulateur financier ?

- Pour quoi

- Quoi : Les mathématiques ? Les principales données utilisées pour trouver le résultat ?

- Quel effort : L’effort de l’équipe de développement qui va essayer de rendre le système interprétable, ainsi que l’effort de l’utilisateur qui va essayer de comprendre la décision du système et/ou son fonctionnement. Par exemple, un patient ne prendra que quelques minutes pour comprendre les données utilisées pour son diagnostic, alors qu’un régulateur prendra des semaines pour vérifier le fonctionnement de l’algorithme.

Un autre point important est d’identifier les causes de la complexité du système. Cette complexité peut venir des données, de l’algorithme (comparez le fonctionnement d’un arbre de décision à celui d’un réseau de neurones), ou encore de sa taille.

On pourra ensuite trouver le bon compromis entre performance et interprétabilité, afin de maximiser l’utilité du système, en s’appuyant sur :

- Du bons sens métier

- De l’humain : pédagogie

- Des outils visuels

- Des bonnes pratiques techniques : bonnes pratiques de développement pour rendre ce que l’on a fait reproductible, traçabilité des données, commencer par un modèle simple pour avoir une baseline qui permettra de mesurer l’apport en termes de performance par rapport à la perte en interprétabilité, etc.

Projets IA dans le domaine médical

Mener à bien un projet innovant est une tâche compliquée. OCTO s’appuie sur trois facteurs clés de succès :

- Alignement entre les différents stakeholders, en s’assurant que tout le monde a la même vision

- Exploration : S’assurer que le projet répond bien à un vrai besoin

- Scalabilité : Faire un MVP (Minimum Viable Product) industrialisable

La e-santé est un domaine de recherche en pleine expansion, dont les éléments principaux (cloud computing, machine learning, IoT, réalité augmentée, chatbot,...) ont pour but d'améliorer le parcours de soin en permettant une médecine préventive et personnalisée.

Un projet d’e-santé a des spécificités qu’Olivier Taraud, Business Developer chez OCTO, a identifié comme suit :

- Large variété de persona, avec des caractéristiques pouvant dépendre de la maladie du patient

- Les données médicales sont considérées comme des données extrêmement sensibles

- Expertise médicale, qu’OCTO a pu acquérir grâce à des consultants ayant de l’expérience dans le domaine de la recherche médicale

- Complexité technique, car différentes technologies sont combinées

On peut donc imaginer que les projets innovants dans le domaine de la santé sont particulièrement complexes, et requièrent un écosystème comprenant des profils aux compétences variées.

Laurent Ribière, consultant chez OCTO, et Isabelle Estournet-Djehizian, Présidente de VINAYA, tous deux bénévoles dans l’association AURA, nous ont fait un retour d’expérience sur ce projet associatif open source et open hardware, où des talents variés (médecins, ingénieurs, data analysts, etc.) conjuguent leur efforts dans le but d’améliorer la qualité de vie des patients épileptiques.

La démarche centrée à la fois sur les patients et les médecins a permis de mettre en évidence deux problématiques majeures : l’imprévisibilité des crises, et plus généralement la difficulté de connaître leur nombre exact entre deux visites médicales, à cause du phénomène d’amnésie post-crise. L’équipe d’AURA se fait aussi accompagner par une philosophe qui travaille sur les aspects éthiques du projet.

Dans le cadre du projet AURA, OCTO a pu contribuer à une librairie python open source d’analyse de rythme cardiaque (https://pypi.org/project/hrv-analysis/), ainsi qu’à une plateforme de suivi des patients en vie réelle.

Takeaways

Il est important de gagner et/ou maintenir la confiance des utilisateurs dans les systèmes IA, afin de profiter de leurs avantages compétitifs en les faisant adopter le plus rapidement et efficacement possible. Cela vient par :

- Un système IA interprétable, puisqu’une décision comprise est une décision plus facilement acceptée et adoptée

- Des interfaces utilisateurs facilitant leur adoption du système IA

- La protection des données personnelles

OCTO Technology est bien outillé pour faire face à ce défi grâce à son écosystème varié, constitué de différentes entités, comme Culture innov’ (comment mener à bien un projet innovant), la tribu UX (User Experience), les tribus data (AIDA, BDA, NAD), RespAI (Responsible Artificial Intelligence), etc.