Compte-rendu Petit-déjeuner : Psychanalyse du chatbot...

Raison d'être et processus de création

OCTO Technology a organisé un petit déjeuner pour présenter les chatbots, leurs enjeux, les technologies qui se cachent derrière. Animé par Michael AKBARALY, expert en agent conversationnel, et Thibaut CANTET, architecte en agent conversationnel au sein de la Tribu Virtual Immersion and Bot Experience (ViBE) à OCTO Technology, ce petit-déjeuner a réuni près de 200 personnes à l’Eurosites République.

Ils ont été introduits par Vincent GUIGUI, responsable de cette offre.

Retrouvez la présentation complète du petit-déjeuner ainsi que la vidéo de la conférence.

Revivez la conférence du point de vue de la twittosphère

Le changement de paradigme des interfaces

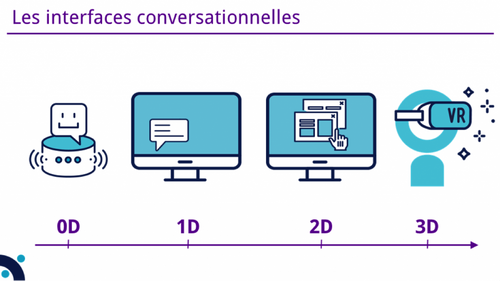

A l’heure actuelle, nous interagissons avec les machines dans des fenêtres, avec une souris et des dispositifs de pointage, le tout au sein d’un écran : on peut assimiler cela à une interface à 2 dimensions. Les actions sont de cliquer, ou de « touch » les éléments pour interagir avec eux.

On voit depuis quelques années l’apparition de nouvelles formes d’interaction avec l’utilisateur. En premier lieu, les expériences immersives comme la réalité virtuelle permettent de plonger l’utilisateur dans un nouvel environnement, cette fois-ci à 3 dimensions, dans lequel il peut se déplacer, entendre et naviguer. A l’inverse, il est aussi possible de retirer des dimensions, et d’arriver aux interfaces à une seule dimension : des chatbots, sujet même du petit-déjeuner. Ici, l’interaction est uniquement textuelle, avec juste un historique de discussion. Les assistants vocaux vont plus loin encore et suppriment l’interface : il s’agit d’interfaces à 0 dimension.

Chatbot : définition

Pour commencer, il convient de définir ce qu’est un chatbot. On en parle beaucoup, mais au final, qu’est-ce que c’est? La définition que nous vous proposons est la suivante :

« Les chatbots sont des programmes dotés d’intelligence artificielle qui peuvent simuler une conversation naturelle avec un humain »

Chatbots est la contraction de « chat » et de « robot ». On trouve également l’expression « Chatterbot » dans la littérature, et il est aussi courant de parler d’agent conversationnel.

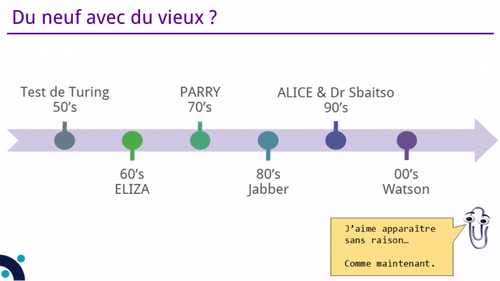

Contrairement à ce que l’on pourrait imaginer, les chatbots ne sont pas nouveaux. Ils existent depuis presque 60 ans !

Le premier à en avoir parlé est Alan Turing, célèbre mathématicien et cryptologue, incarné au cinéma par Benedict Cumberbatch dans The Imitation Game (2014). En 1950, il propose dans son ouvrage Computing Machinery and Intelligence un test toujours d’actualité : le test de Turing. Celui-ci permet de juger de la faculté d’une machine à imiter une conversation humaine. Le principe est de tromper un ou plusieurs examinateurs en faisant passer un programme informatique pour un humain. Un robot passe le test de Turing s’il est considéré comme un humain 30 % du temps, pendant un échange d’au moins cinq minutes.

Le premier robot à s’approcher du test de Turing est ELIZA. Développé par Joseph Weizenbaumn ce programme simule un psychothérapeute en reformulant chacune des phrases du patient en question. C’est aussi la première fois que certains utilisateurs developpe un lien émotionnel avec un robot. Dans les années 70, PARRY est un chatbot simulant un schizophrène paranoïaque.

Pour terminer en 2011, où IBM envoie son intelligence artificielle, Watson, au jeu télévisé de culture générale Jeopardy. Les chatbots commencent à se démocratiser suite à la victoire de l’IA face à deux champions du jeu...

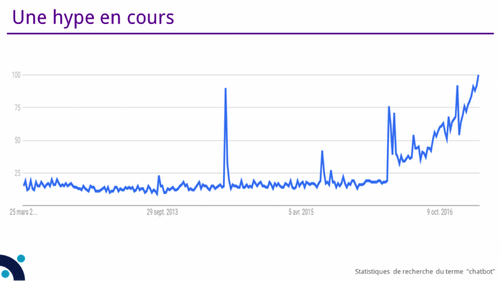

Malgré 60 ans d'existence, les chatbots ne suscitent l'intérêt que depuis quelques années, voire quelques mois seulement.

Factualiser la hype autour des chatbots

Les chatbots sont au centre des prédictions technologiques : le mot « chatbot » est un « buzzword ». Factualisons un peu cette hype.

Tout d’abord, ces tendances se voient facilement sur Google Trends : les courbes montrent un gain d’activité net depuis avril 2016, date à laquelle Facebook a annoncé l’ouverture d’une plateforme de développement de chatbots sur Messenger.

On peut aussi voir un pic en juin 2014. Il s’agit du moment où Eugene Goostman fut le premier chatbot à passer le test de Turing en prétendant être un adolescent ukrainien de 13 ans vivant à Odessa, lors d’un événement organisé par la Royal Society of London et l’Université de Reading.

Mais les Google Trends ne sont pas les seules démontrer l’intérêt croissant pour les chatbots. Les cabinets d’étude leur montrent aussi un intérêt et leur prédisent même un avenir radieux. Gartner prévoit qu’en 2020, 85 % des échanges entre un client et une entreprise se feront sans l’intervention d’un humain. Du côté des grands acteurs du web, l’engouement est le même : « Chatbots are the new apps » pour citer Satya Nadella, CEO de Microsoft, en 2016.

Les GAFAM font aussi vivre cet écosystème. Google, par exemple, a acquis Api.ai, moteur de langage naturel et a lancé Allo, une nouvelle messagerie instantanée. Son assistant personnel, Google Assistant concurrence Amazon et son Alexa. Même son de cloche du côté de Facebook, qui a acquis wit.ai, un moteur de langage naturel, qui dispose de deux messageries instantanées, WhatsApp et Facebook Messenger.

D’autres plateformes s’imposent également, provenant d’acteurs indépendants, comme Kik, principalement utilisé par les jeunes américains, Slack, utilisé en entreprise ou WeChat, en Chine.

De quoi parle-t-on ?

Mais alors, pourquoi les chatbots sont-ils tendance en ce moment alors qu’ils existent depuis 60 ans ?

En réalité, le buzz n’est pas réellement sur les chatbots : il est plus sur les plateformes sur lesquelles se déploient les chatbots. En effet, ces applications extrêmement populaires ont, pour la plupart, ouvert leurs discussions aux agents conversationnels.

Une catégorie plus spécifique de plateforme de chatbots est née : il s’agit des assistants personnels. 8 millions d’américains disposent déjà d’un Amazon Echo. Ce dispositif intègre Alexa, l’assistant personnel de Amazon mais la concurrence est rude avec Google Home, qui intègre Google Assistant. Ces deux assistants permettent aux développeurs d’ajouter des fonctionnalités : les “Skill” d’Alexa et les “Actions” de Google.

Ces assistants personnels, déjà présents dans nos poches depuis un certains temps, comme Siri d’Apple ou Cortana de Microsoft, vont donc bientôt envahir les maisons françaises grâce à ces deux dispositifs. A plus court terme, on peut prévoir qu’ils seront présents dans nos objets du quotidien, comme dans les voitures.

Les raisons du déferlement

« App Fatigue » et les applications de messagerie

« There’s an app for that » Apple

Le message d’Apple n’a jamais autant été d’actualité : « Il y a une application pour ça ». En effet, avec 2 millions d’applications disponibles sur l’App Store et 2,2 millions sur Google Play, les différents app stores sont saturés. Néanmoins, seulement 5 applications sont utilisées en moyenne quotidiennement. En effet, les utilisateurs ne veulent plus télécharger, comprendre comment marche une application, puis la mettre à jour à chaque nouvelle version : le « Gold Rush » des applications est fini.

Certaines applications ont su malgré tout tirer leurs épingles du jeu : il s’agit des applications de messagerie instantanée. En effet, 85 % du temps d’utilisation d’un smartphone est sur une de ces applications ; au point même que les quatre plus grandes « messaging app » ont plus d’utilisateurs actifs par mois que les quatre plus grands réseaux sociaux ! De plus, ces applications ne sont pas uniquement des applications de messagerie : elles permettent d’envoyer des photos, des vidéos, même des filtres comme sur Snapchat. « Not just a messaging app ».

L’intelligence artificielle rendue accessible (AIaaS)

Les progrès majeurs de l’Intelligence Artificielle ces dernières années l’ont rendue accessible à un plus grand nombre. Des briques sont mises à disposition des développeurs, comme les technologies de compréhension du langage naturel (Natural Language Understanding) ou encore de Machine Learning et de reconnaissance vocale.

Grâce à l’apparition de nouvelles plateformes de messagerie, à l’ouverture de leur plateforme de développement de bots ainsi qu’aux progrès dans l’intelligence artificielle, on assiste à la création d’un large écosystème autour des chatbots

Quels sont les intérêts business ?

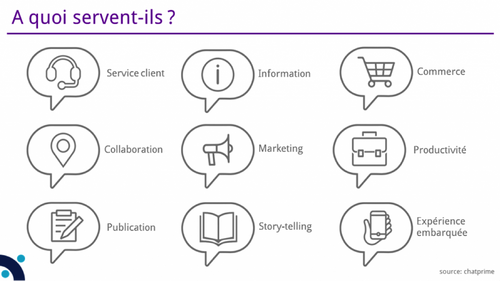

Les chatbots peuvent répondre à une multitude de cas d’usage, allant du service client, à l’expérience embarquée.

Il existe des chatbots de sites d’information, comme celui du Guardian, qui permettent d’envoyer aux utilisateurs les dernières nouvelles chaque matin, ou encore les « breaking news ». Pour les expériences embarquées, l’exemple le plus parlant est celui des assistants personnels tels qu’Amazon Alexa. Pour le commerce, H&M et Sephora ont déjà expérimenté des chatbots sur Facebook Messenger ou Kik.

Cas du service client

Les chatbots peuvent apporter un réel gain pour les marques qui décident d’en mettre en place. Tout d’abord, ils participent à l’identité de la marque sur le web, en fonction de la personnalité du chatbot. Ils permettent d’être toujours disponible et de répondre immédiatement aux demandes du client. Ils proposent aussi une relation privée : ce qui n’est pas le cas d’un tweet à un service client par exemple. Enfin, cela permet de récolter des données utilisateurs de qualité, afin d’améliorer le service rendu.

Les chatbots permettent aussi une personnalisation du service grâce à la relation privée avec l’utilisateur. En reconnaissant les habitudes de l’utilisateur, le chatbot pourra s’adapter et proposer des contenus plus pertinents pour ce dernier.

De plus, les chatbots sont « multi-canaux » et « mobile-first » : on peut accéder à toutes les plateformes de messagerie depuis tous les terminaux. On remarque aussi l’émergence d’un nouveau marché autour des chatbots. L’idée est d’aller chercher l’utilisateur là où il se trouve, c’est-à-dire sur les applications de messagerie. Celles-ci commencent à proposer des Bot Stores, à l’instar des App Stores des dernières années.

En conclusion, l’impact des GAFAMs et le fait que la technologie soit devenue abordable ont permis à un écosystème riche de se développer, simplifiant le développement et le déploiement de chatbots sur plusieurs plateformes. L’intérêt business est inévitable.

Mais comment ça marche ?

Ces robots vont donc révolutionner notre interaction avec la machine : celle-ci va s’adapter à l’humain et non plus l’inverse.

Actuellement, nous sommes habitués aux interactions à deux dimensions : des fenêtres sur un écran plat, on « clique » ou on « touch ». La réalité virtuelle nous permet d’entrer dans une interaction à 3 dimensions : on peut se mouvoir au sein d’un environnement virtuel et interagir avec. Les chatbots textuels, quant à eux, peuvent être assimilés à des espaces à une dimension : seul l’historique de la discussion permet un retour arrière. Enfin, en passant aux interfaces vocales nous arrivons aux interactions à aucune dimension : l’utilisateur n’a que sa mémoire pour retrouver l’historique de la discussion.

La conversation est donc au centre de l’interaction : on ne parle plus de Graphical User Interface, mais de Conversational User Interface. Elle peut être textuelle, à base de chat et s’intégrer au sein d’applications de messagerie comme Facebook Messenger ou Slack ; ou au sein même d’un site web. L’utilisateur va interagir comme s’il écrivait à un humain.

Mais cette conversation peut aussi être parlée, en utilisant uniquement la voix. Cette fois-ci, l’utilisateur va parler exactement comme à un humain. Cette solution demande de nouvelles briques, comme la synthèse de voix et la reconnaissance automatique de discours (l’ASR – Automatic Speech Recognition) afin de proposer une discussion la plus fluide possible. N’ayant plus de support visuel, ces interfaces permettent une interaction plus naturelle. En revanche, elle représente de nouveaux défis, comme un design de discussion à bien penser : il n’est plus possible de donner une liste de réponses possibles. En effet, au-delà de cinq réponses, l’être humain n’est plus capable de retenir les possibilités. Le design de la discussion est donc primordial.

On assiste bien là à un changement de paradigme : l’utilisateur n’a plus à connaître le fonctionnement de l’application – où appuyez, comment revenir au menu principal, … – c’est l’application qui s’adapte à l’humain. L’adoption du service en est donc plus aisée, permettant de toucher plus rapidement une large population cible.

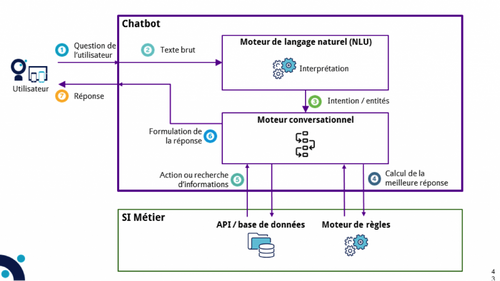

Architecture

Un chatbot en tant que tel est composé de plusieurs briques fonctionnelles.

L’utilisateur, grâce à son smartphone ou son ordinateur, va entrer un message en langage naturel. Celui-ci va être analysé par le moteur de langage naturel, dont le rôle est de déterminer le sens de l’entrée utilisateur. Grâce à cette analyse, le moteur conversationnel va pouvoir déterminer l’action à effectuer ou l’information à aller chercher, puis enverra la réponse adéquate à l’utilisateur.

Focalisons-nous maintenant sur une brique en particulier : le moteur de langage naturel.

Moteur de langage naturel

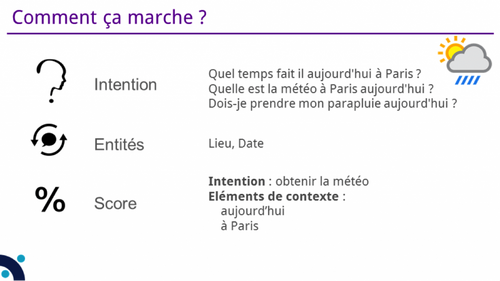

Le rôle du moteur de langage naturel (on parle de NLU – Natural Language Understanding) est primordial au sein d’un chatbot : il est en charge de comprendre ce que veut dire l’utilisateur. La compréhension du langage humain est un vrai défi technologique : il faut comprendre la volonté de l’utilisateur quelle que soit la formulation utilisée.

Les trois phrases suivantes peuvent être envoyées à un chatbot proposant un service météo :

- Quel temps fait-il à Paris aujourd’hui ?

- Dois-je prendre mon parapluie à Paris aujourd’hui ?

- Quelle est la météo à Paris aujourd’hui ?

Toutes représentent la même demande ; le défi pour le moteur naturel est donc de déterminer que ces trois phrases doivent actionner les mêmes actions.

Pour cela, il va commencer par extraire deux caractéristiques, qui vont l’aider à déterminer le sens.

- L’intention associée au message. Elle correspond à ce que l’utilisateur a cherché à faire ou à savoir en envoyant ce message. Cette donnée correspond à son objectif. Elle est scorée, c’est-à-dire qu’un indice de confiance lui est associé par le moteur de langage naturel.

- Les entités. Ce sont des éléments de contexte qui permettent d’affiner l’intention de l’utilisateur, comme le lieu, la date, l’objet…

Dans l’exemple précédent, les trois phrases partagent la même intention : demander la météo, ainsi que les mêmes entités : aujourd’hui et à Paris.

La machine qui apprend

Les moteurs de langage naturel sont une forme d’intelligence artificielle : ils s’appuient sur les technologies d’apprentissage automatisées (machine learning), et plus spécifiquement sur l’apprentissage profond (deep learning) pour classifier les intentions et extraire les éléments de contexte. Cela veut dire que la machine va apprendre, au fur et à mesure de l’utilisation, à comprendre plus de phrases entrées par l’utilisateur.

Pour mieux comprendre, on peut utiliser l’analogie d’un enfant qui apprend un concept. Par exemple, pour une chaise, il faut des pieds et une assise. Pour que l’enfant puisse différencier une chaise d’un fauteuil ou d’un siège, il aura besoin d’en voir plusieurs types. Idem pour en identifier les différents modèles. Plus l’enfant verra de chaises, mieux il saura reconnaître l’objet en tant que tel.

Une phase d’entraînement est donc nécessaire avant le déploiement d’un chatbot. Il faut consolider un jeu de données – un dataset – de phrases types, idéalement créé par plusieurs personnes, afin que le chatbot puisse apprendre à reconnaître les phrases de l’utilisateur.

Par où commencer ?

Il y a deux approches pour créer son propre chatbot : intégrer des solutions techniques ou prototyper rapidement.

- La première solution est de tout développer. Il faudra choisir le framework du chatbot, ainsi que le moteur de langage naturel.

Parmi les frameworks les plus connus, il existe le botframework de Microsoft, en C# ou Node.JS, Lita en Ruby, ErrBot en Python, Hubot en CoffeeScript, ou encore Recast.ai dans plusieurs langages.

Les moteurs de langage naturel sont pour la plupart en SaaS, comme Wit.ai (Facebook), Api.ai (Google), LUIS (Microsoft) ou encore Rasa NLU.

Cela permet une maîtrise complète du chatbot, de pouvoir faire appel à des APIs métier. En revanche, cela devient un vrai projet de développement, coûteux.

- La seconde solution est d’utiliser un « botbuilder », une solution de création de bots.

Elle permet de créer le chatbot grâce à une interface graphique, en évitant le maximum de code.

Il en existe plusieurs sur le marché, comme chatfuel, pandorabots, motion.ai, gupshup, vocalapps. Les moteurs de langage naturel peuvent aussi servir à déployer un bot, comme wit.ai, api.ai ou recast.ai.

Ils permettent de pouvoir développer un chatbot sans avoir de connaissances en développement et d’arriver à un prototype très rapidement. Néanmoins, ils ne permettent pas (ou difficilement) d’accéder au SI métier, et d’être généralement lié à une plateforme de développement.

Ici, à Octo, on vous recommande d’utiliser les botbuilders pour la communication événementielle, ou pour valider ce canal de communication ou le modèle conversationnel. En revanche, on vous recommander de développer votre solution dès lors qu’il est question d’intégration à votre SI ou de fonctionnalités avancées.

Conseils pour votre chatbot

A quoi doit répondre mon chatbot ?

En répondant à cette question, vous allez pouvoir déterminer les cas d’usage et de quelle manière les mettre en place. Votre chatbot doit-il aller chercher de l’information, comme un chatbot permettant de recevoir des alertes météo ? Votre chatbot doit-il collecter de l’information, comme pour réserver un ticket de train ?

A qui s’adresse-t-il ?

En particulier sur les questions d’âge et de géographie.

En effet, la réponse à cette question va déterminer le choix de la plateforme utilisée pour déployer votre chatbot.

Par exemple, les jeunes américains utilisent Kik, alors que Wechat est beaucoup plus populaire en Chine. De même, les baby-boomers vont être plus réceptifs à un chatbot par SMS.

La personnalité de votre chatbot est importante et va conditionner un bon nombre de vos communications. Cet aspect essentiel lors de la conception d’un chatbot passe par plusieurs axes. Tout d’abord, nous vous conseillons de toujours présenter votre chatbot, et d’annoncer sa mission. En le faisant, vous réduisez le domaine d’utilisation de votre chatbot et permettez aux utilisateurs de bien déterminer ce qu’ils peuvent ou ne peuvent pas faire. Il faut aussi choisir le ton que va utiliser votre chatbot ; formel ou plutôt décontracté. Vous pouvez aussi appuyer ce choix de ton en utilisant des emojis. Enfin, le choix de l’avatar peut aider à déterminer sa personnalité.

En revanche, nous vous conseillons de ne pas mentir et de préciser aux utilisateurs qu’ils parlent à un robot et non une personne humaine. Même si l’intelligence artificielle parvient de mieux en mieux à comprendre le langage naturel, les chatbots ne sont pas prêts à passer le test de Turing. Il vaut mieux donc annoncer dès le début de la discussion qu’il s’agit d’une intelligence artificielle, afin de ne pas frustrer les utilisateurs en cas de mauvaise réponse.

Les chatbots sont nouveaux pour les utilisateurs, ils n’ont pas encore l’habitude d’en rencontrer. Il est donc nécessaire au chatbot de guider la conversation en indiquant quelles options sont disponibles. Un chatbot n’est jamais capable de répondre à tout. Même s’il propose une conversation fluide, il arrivera toujours un moment où l’utilisateur se retrouvera dans une impasse. Il est aussi fréquent que les utilisateurs posent intentionnellement des questions hors du périmètre du chatbot ou essaient de le piéger. « Désolé, je ne comprends pas » n’apporte ni de réponse ni d’alternative. Le risque est alors de voir la conversation se terminer. Il faut que le chatbot aide l’utilisateur à préciser sa question, lui propose une alternative ou lui explique ses domaines de compétences. De plus, pour ne pas ajouter trop de lourdeur lors de la conversation, il n’est pas nécessaire que le chatbot demande toujours une confirmation.

Mais il est important de demander une validation dans les cas suivants :

- actions qui ont une portée publique. Exemple : publication sur un réseau social.

- actions qui affectent une autre personne. Exemple : envoi d’un message à quelqu’un.

- actions qui impliquent une transaction bancaire. Exemple : achat.

Il est très probable que l’utilisateur ne donne pas tous les éléments nécessaires pour une étape d’une conversation ou que celle-ci ne puisse pas être déduite du contexte courant. Le chatbot doit alors demander les informations manquantes une par une et non pas toutes en même temps.

Enfin, le dernier conseil que nous donnons est parfaitement illustré par l’une des citations d’Octo :

Préférez un chatbot qui s’occupe très bien d’un cas d’usage plutôt qu’un chatbot qui s’occupe moyennement de plusieurs cas d’usage.

Démonstration de l’entraînement d’un chatbot

Nous avons développé un chatbot interne permettant aux Octos de consulter l’annuaire interne, AskBob, grâce à un bot présent sur Slack.

Pour ce faire, nous avons utilisé Api.ai, le moteur de langage naturel de Google. Il a été nécessaire d’entraîner le chatbot avant, grâce à l’interface proposé par api.ai ou par des APIs.

Retour d’expérience : un chatbot pour une collectivité locale

OCTO a été contacté pour une mission pour une collectivité locale. Objectif : réaliser un chatbot pour simplifier l’accès par les usagers aux services numériques. Lors de cette mission, les objectifs étaient de mettre en place un chatbot connecté au SI, et tester la pertinence d’une interface conversationnelle.

Les actions que nous avons dû mettre en place

Un premier temps a été consacré à de l’évangélisation : faire comprendre ce qu’est (ou ce que n’est pas) un chatbot, et ce à chaque intervenant, dès son arrivée dans le projet. Deuxième étape : déterminer les cas d’usage pertinents pour leur sujet. La première idée a été une FAQ interactive, pour que les usagers puissent trouver la réponse le plus efficacement possible.

Nous nous sommes ensuite intéressés au Support Niveau 1 : de l’aide au diagnostic Réseaux / VoIP ; et si la résolution ne peut pas être immédiate, le chatbot peut créer des tickets.

Cela permet de faire gagner de l’autonomie à l’utilisateur dans la résolution et le signalement d’incidents, mais aussi du temps à ne plus rédiger autant d’emails.

La suite de notre intervention a été de benchmarker plusieurs moteurs de langage naturel afin de trouver la solution la plus adaptée à leur domaine d’intervention. Nous avons comparé :

- LUIS, de Microsoft ;

- Api.ai, de Google ;

- Wit.ai, de Facebook ;

- Recast.ai, une start-up française.

Les résultats de ce benchmark nous ont orienté vers wit.ai, confirmant son niveau de machine learning. De plus, le modèle gratuit et l’intégration aisée dans Facebook Messenger ont acté ce choix.

Il a fallu ensuite convaincre le client d’utiliser un moteur en SaaS. Celui-ci est simple à mettre en oeuvre à très bas coût, et se révèle fiable et efficace dans les cas d’usage proposés.

Finalement, la dernière étape a été l’entraînement. Pour cela, il a fallu constituer un jeu de données comprenant un nombre conséquent de phrases types que l’utilisateur pourrait entrer. Nous avons pour cela recommandé de mobiliser plusieurs personnes afin de diversifier l’apprentissage. En effet, si une personne unique s’occupe de l’entraînement, le chatbot ne pourra comprendre que cette personne en particulier.

Limites

En dépit des potentialités évoquées, il convient de prendre un peu de recul sur le sujet, et d’analyser aussi les limites des chatbots.

Pour le moment, ils ne comprennent que des phrases simples. Les phrases compliquées, avec des doubles négations par exemple, ne sont pas encore reconnues. De même, l’ironie peut être un frein à la bonne compréhension d’une phrase par un moteur de langage naturel.

De même, l’idée d’accessibilité pour un chatbot n’est pas encore définie. Cette notion n’existe pas encore pour ces interfaces naturelles, privant ainsi les déficients visuels es chatbots textuels et les malentendants des chatbots vocaux.

Enfin, les chatbots demandent encore une supervision lors de l’entraînement, mais aussi lors de l’utilisation : ils ne sont pas prêts à tous nous remplacer.

Mais dans un futur plus ou moins proche, de nouvelles fonctionnalités développeront les cas d’utilisation des chatbots.

Tout d’abord, une personnalisation encore plus poussée sera possible, en fonction de l’utilisateur et des informations dont dispose le chatbot.

Ensuite, le chatbot pourra reconnaître les émotions et les sentiments : pour l’instant, la machine comprend des intentions ou des entités, des éléments neutres. En revanche, dans le cas d’un chatbot pour le service client, il est intéressant de déterminer les émotions de l’utilisateur, comme son niveau de stress ou d’énervement, afin de trouver les réponses les plus adaptées à chaque humeur.

Enfin, le chatbot pourra se souvenir des conversations antérieures, et utiliser ces informations pour enrichir la conversation courante.

Conclusion

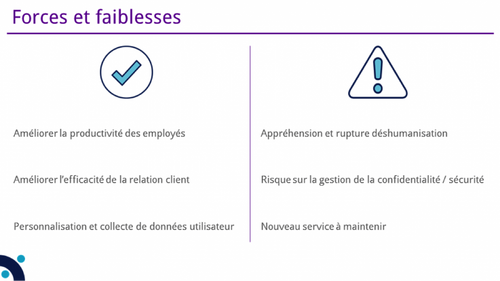

Après avoir fait le tour de l’écosystème des chatbots, de leurs intérêts business, et de la partie technique, il apparaît clairement que ces interfaces nouvelles ont leurs forces et leurs faiblesses.

Ils améliorent la productivité des employés et l’efficacité de la relation client grâce à ce nouveau type d’interface. Ils offrent une expérience personnalisée et privée à l’utilisateur, tout en permettant de récupérer des données de qualité.

En revanche, ils sont encore sources d’une certaine appréhension chez quelques clients, qui peuvent refuser de parler à un robot. Sans compter le risque de déshumanisation du métier. De plus, la gestion de la confidentialité et de la sécurité dépend des plateformes sur lesquels les chatbots sont déployés, qui appartiennent pour la plupart aux GAFAMs. La confidentialité et la sécurité sont donc des paramètres à prendre en compte lors du déploiement de votre chatbot. Enfin, il y a aussi des coûts de maintenance liés aux chatbots, et comme tout nouveau service, ceux de la formation indispensable qu’il nécessite.

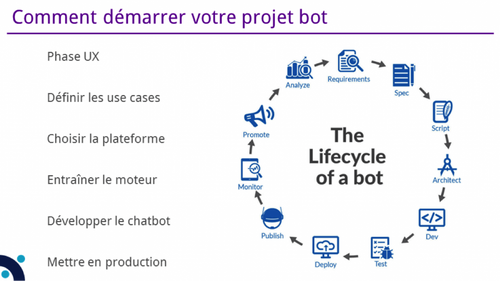

Pour démarrer votre projet de chatbot, il est nécessaire de penser à de nouvelles étapes lors de sa réalisation :

- Tout d’abord, la phase UX : définir la personnalité du chatbot, etc.

- Ensuite, définir les use cases intéressants et en déduire les scénarios conversationnels associés.

- Puis, choisir la plateforme. Chaque plateforme a ses avantages et ses inconvénients. A visée plutôt professionnelle ? Préférez Slack. Pour un déploiement en Chine ? WeChat sera plus adaptée.

- Il faut aussi entraîner le moteur de langage naturel et pour cela, générer un corpus d’entraînement afin qu’il comprenne un maximum de phrases.

- Ensuite, développer le moteur ;

- Puis finaliser par une mise en production.

Les chatbots font résolument partie de la stratégie numérique des entreprises. Ils sont un nouveau canal de communication au même titre que le web, les applications mobiles et les API. Ils sont de plus en plus utilisés et offrent de nouvelles possibilités d’interaction utilisateur (B2E, B2C). À chaque entreprise de trouver son cas d’usage le plus pertinent, afin d’acquérir la compétence nécessaire à son bon développement.

Vous voulez savoir comment intégrer intelligemment les chatbots dans votre entreprise ? Rejoignez la formation OCTO Academy sur les chatbots le 22 et 23 mai. Les inscriptions sont ouvertes : http://www.octo.academy/fr/formation/108-chatbot-creer-son-premier-agent-conversationnel